Google AI ha da pochi giorni pubblicato sul suo blog un particolare post che spiega l’enorme qualità del suo nuovo algoritmo, capace di migliorare immagini a bassissima risoluzione. Il nuovo Google Ehnance, infatti, sembrerebbe estrarre informazioni digitalmente da foto con qualità bassissima (si parla in media di file 64 x 64 px) e di trasformare in immagini fotorealistiche.

Google AI nasce nel 2017 come divisione dell’azienda americana incentrata soprattutto sull’intelligenza artificiale (da dove prende il nome). Il post intitolato “High Fidelity Image Generation Using Diffusion Models” (che tradotto vuol dire “Creazione di immagini ad alta fedeltà utilizzando modelli di diffusione”) spiega come i ricercatori abbiano sviluppato questa nuova tecnologia per portarla a risultati mai visti prima.

Google Enhance: un aumento costante della risoluzione

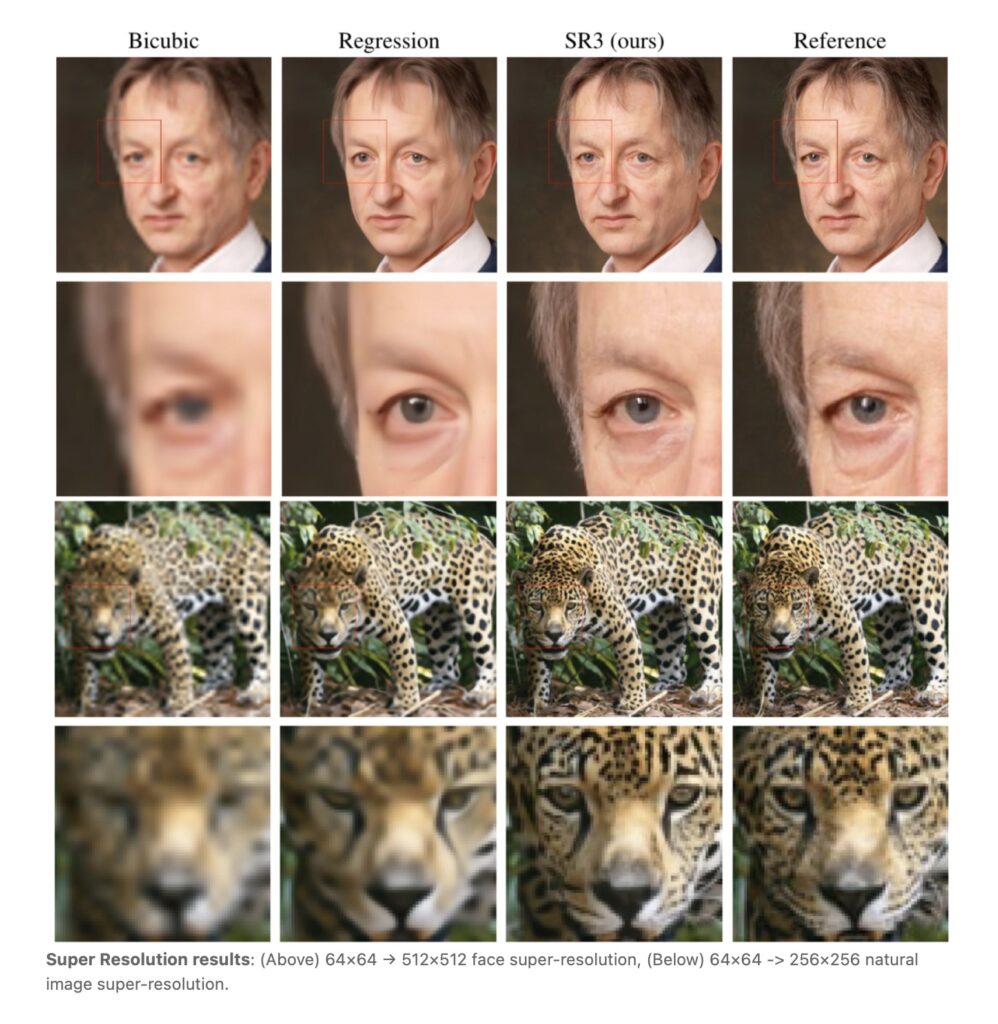

Il primo passo fatto da Google Enhance per l’upscaling è l’utilizzo di una tecnologia chiama Super Resolution. In pratica sfruttano fanno un upscale (cioè il normale ingrandimento dell’immagine) perdendo molto dettaglio e poi creano un’immagine di puro rumore della risoluzione voluta. Tramite tecnologie di riduzione del rumore riescono a creare una foto perfetta con una risoluzione pari a quattro volte quella di input.

I ricercatori di Google AI sfruttano questo metodo più e più volte utilizzando modelli di diffusione in cascata (chiamati CDM) per applicare in maniera intelligente il rumore gaussiano e la sfocatura dell’immagine in output, per poi ricominciare daccapo. Secondo BigG questa tecnologia produrrebbe degli eccellenti risultati anche sui ritratti sia delle persone che degli animali.

L’azienda ha infatti dichiarato che con diversi tipi di foto si riescono a raggiungere anche le 4 o 8 volte la risoluzione di input. A conti fatti sembrerebbe una tecnica che potrebbe sconvolgere il mercato, andando contro anche alle strabilianti tecnologie di Adobe Sensei (introdotta nell’ultima versione di Photoshop) ed eviterebbe anche il problema di dover utilizzare sensori fotografici sempre più densi di pixel.

Avere meno megapixel, infatti, genererebbe più gamma dinamica all’interno di una foto (cioè meno foto con bianchi e/o neri bruciati) e meno rumore digitale ad alti ISO (come avviene in mirrorless come Sony a7S III). BigG ha messo alla prova foto di risoluzione bassissima come 64 x 64 px trasformandole in immagini fotorealistiche 1024 x 1024 px, senza il minimo sforzo.

Sul blog, i ricercatori Google affermano che questa tecnologia “migliora le prestazioni dell’upscaling a livelli prima inimmaginabili” e che non si hanno ancora del tutto chiari i limiti di questa tecnica.

Fonte [DPReview]

![Nikon Z9: la mirrorless che mostra i muscoli [AGGIORNATO] 4 Nikon Z9 Annuncio Mirrorless Full Frame](https://www.drcommodore.it/wp-content/uploads/2021/10/nikon-z9-annuncio-drc.jpg)