ChatGPT, il rinomato Chat Generative Pre-trained Transformer sviluppato da OpenAI, negli ultimi tempi ha fatto molto parlare di sè. Che si tratti di Microsoft o di Meta, questa nuova frontiera del mercato sta attirando attenzione anche dai pezzi grossi del settore, i quali osservano molto da vicino il modello ChatGPT e la sua rapida ed improvvisa espansione.

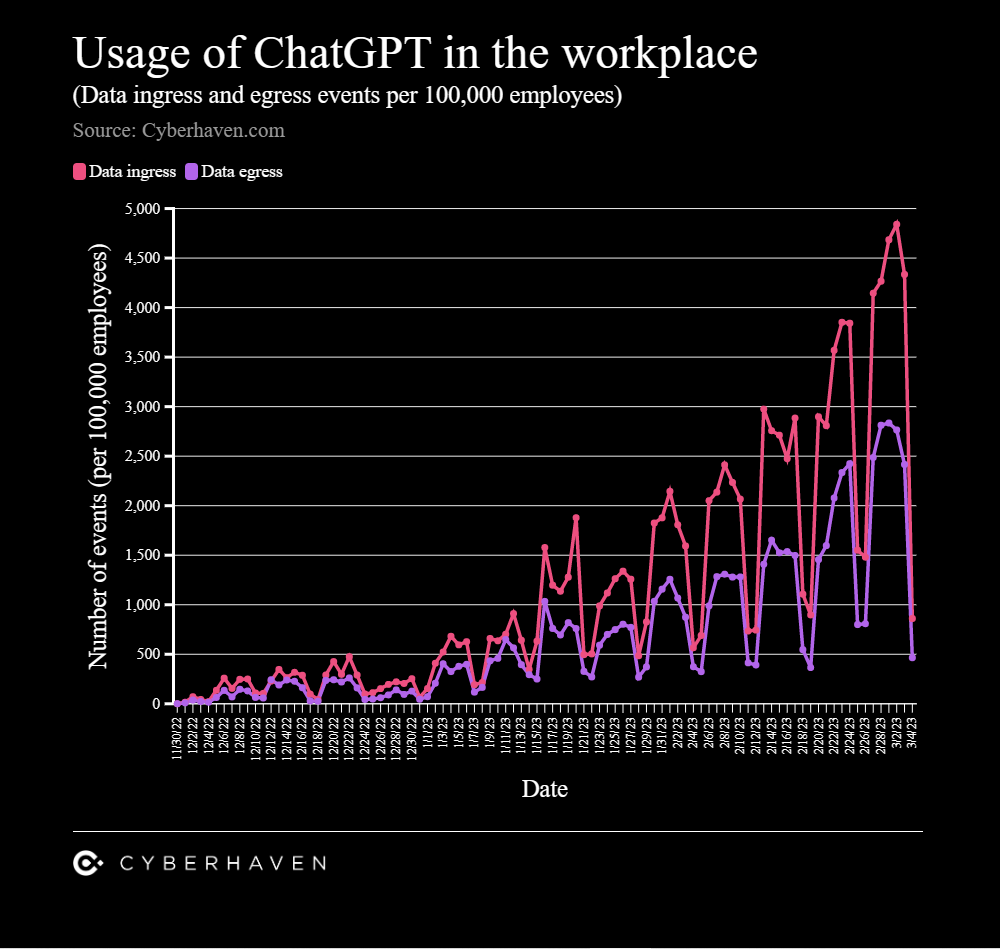

Non tutto è oro ciò che luccica, tuttavia. Secondo una ricerca dei Cyberhaven Labs, infatti, risulta che moltissimi dipendenti di diverse corporazioni starebbero facendo trapelare (e quindi compromettendo) i dati sensibili aziendali tramite l’utilizzo quotidiano di ChatGPT.

Più nello specifico, si registra che oltre 1.6 milioni di dipendenti di diverse aziende abbiano fatto uso, almeno una volta, di ChatGPT. Il 5.6% avrebbe utilizzato l’AI durante l’orario lavorativo e approssimativamente il 5% di loro avrebbe fornito i dati sensibili della propria azienda al Chat Generative Pre-trained Transformer.

ChatGPT ed i dati sensibili a rischio

Di per sé, i valori in percentuale di tali “fughe” di dati sensibili non risultano come qualcosa di nuovo; in molteplici occasioni e pressoché ogni giorno tali informazioni vengono manipolate in rapporti di quantità ben maggiori.

Ciò che preoccupa, tuttavia, è il fatto che ChatGPT utilizzi tali dati sensibili per costruire la propria base di conoscenza, condividendo quindi pubblicamente le informazioni fondate attorno ad essi.

L’utilizzo di ChatGPT sta diventando un problema serio negli ambienti lavorativi dato che può, potenzialmente, causare la fuga di dati sensibili e riservati. Per questo motivo, aziende come JP Morgan e Verizon stanno bloccando ai propri dipendenti l’accesso al chatbot per preoccupazioni legate ai dati riservati.

Gli analisti di Cyberhaven riferiscono che meno dell’1% (0,9%) dei dipendenti è responsabile dell’80% delle fughe di notizie causate dall’immissione di dati aziendali nel chatbot. Questa percentuale potrebbe aumentare rapidamente nei prossimi mesi con l’integrazione della tecnologia in più servizi.

Ciò, tuttavia, va a scontrarsi con la percezione, sia dei dipendenti che delle aziende stesse, che l’utilizzo di ChatGPT incrementi notevolmente la produttività sul luogo di lavoro.

I ricercatori, inoltre, hanno monitorato che i dipendenti spesso copiano i dati dal popolare chatbot e li incollavano altrove, come un’e-mail aziendale, Google Docs o il proprio editor di codice sorgente. Hanno quindi notato che i dipendenti copiano/importano i dati dal chatbot più di quanto incollano i dati aziendali in ChatGPT, in un rapporto quasi 2 a 1.

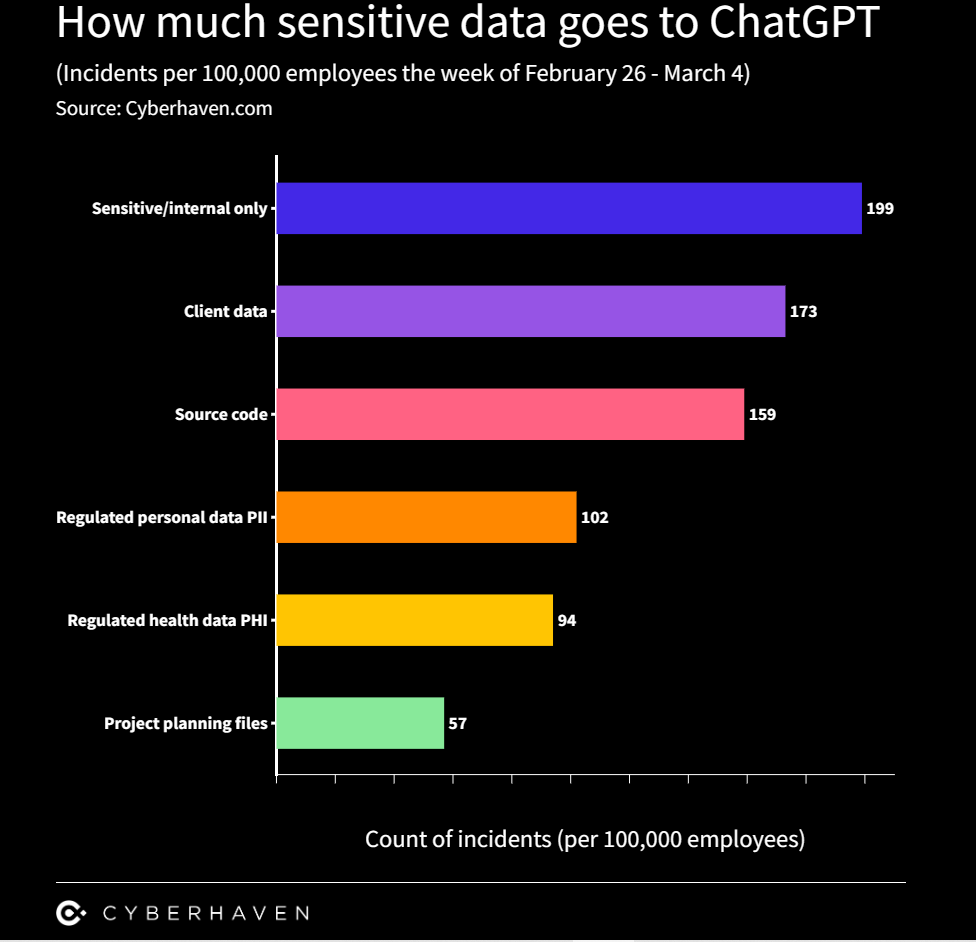

È stato sottolineato, infine, che le aziende (anche quelle di media dimensione) fanno trapelare dati sensibili a ChatGPT centinaia di volte ogni settimana. Ad esempio, durante la settimana dal 26 febbraio al 4 marzo, i lavoratori di un’azienda con 100.000 dipendenti hanno fornito documenti riservati al chatbot basato sull’intelligenza artificiale 199 volte, dati dei clienti 173 volte e codice sorgente 159 volte.

Fonti: Security Affairs, Cyberhaven