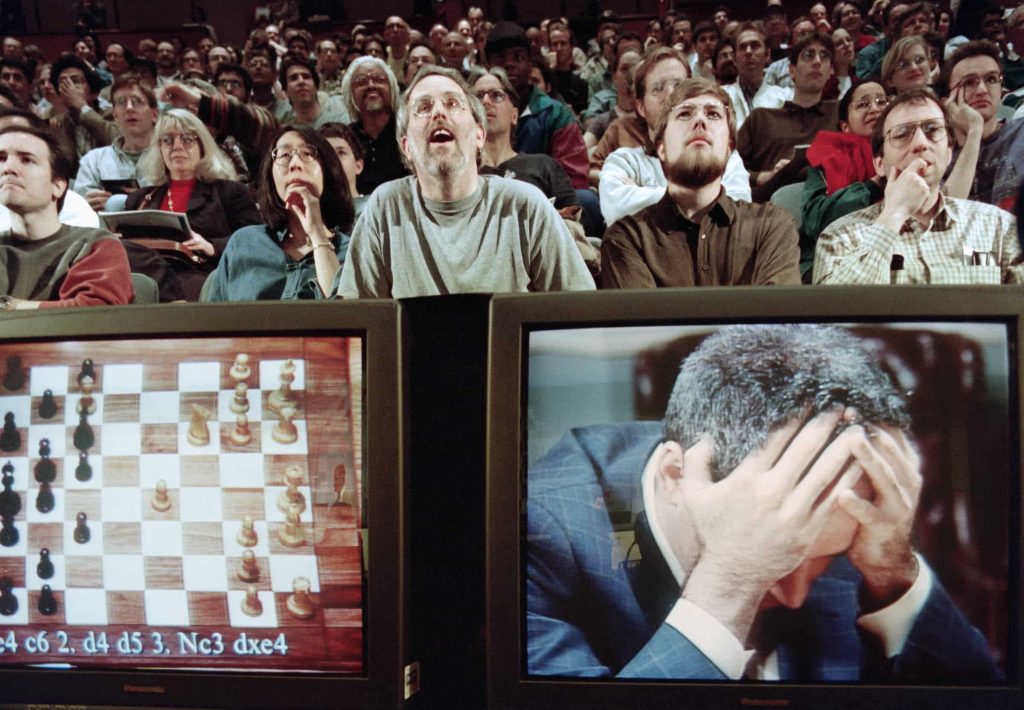

Era il 1997 quando Garry Kasparov, campione mondiale di scacchi, sfidò Deep Blue sulla tavola bianca e nera per mostrare le potenzialità del supercomputer di casa IBM. Un uno contro uno passato alla storia e che ha spianato la retta via per vincere, più di recente, a un altro gioco ancor più complesso: Go. Tavole diverse, pedine sempre bianche e nere, regole frutto della geniale e antica mente cinese, ma stesso risultato: AlphaGo, AI prodotta da DeepMind, ha sconfitto il campione Lee Sedol portandolo anche al ritiro.

A oggi l’impiego dell’AI tocca molti ambiti e i veri test li vedono anche i nerd su StarCraft (dove l’intelligenza artificiale ha vinto), Dota 2 (anche qui ha vinto) e a breve si prospetta una grande partita a Magic: The Gathering, dove il risultato non è “computazionalmente deducibile”. Cosa significa tutto questo? Che siamo una specie destinata a soccombere al nostro stesso prodotto? Oh, no. E l’invito a sfruttare tale tecnologia viene direttamente da Kasparov, dal Vaticano, da migliaia di esperti.

“Penso sia importante che le persone riconoscano l’elemento che è l’inevitabilità. Quando sento dire che l’AI sta correndo per distruggere le nostre vite, bisogna dire no, anzi è lenta. Ogni tecnologia distrugge i lavori e posti di lavoro prima di crearne altri. Dico sempre che sono stato il primo a vedere il proprio lavoro minacciato da una macchina. Ma ci sono macchine diverse e il ruolo dell’uomo è capire esattamente cosa fanno. Alla fine, si tratta soltanto di combinare noi e loro. […] La tecnologia è la ragione principale per cui molti di noi sono ancora vivi per lamentarsene.”

L’era dell’AI è vicina: che fare?

Kasparov in alcune ultime interviste non si è risparmiato dal manifestare un suo pensiero: l’AI cambierà il 96% dei lavori attuali. Eliminandoli o modificandoli, non si sa. L’unico fattore noto è che dove sta creatività umana, lì le macchine non potranno intervenire e sostituire l’uomo.

Si parla di robot-uscieri, robot-contabili, si vedono già macchine in grado di muoversi autonomamente – vedi l’Autopilot Tesla. I lavoratori ormai stanno imparando ad accettare il loro futuro, la loro nuova posizione nel meccanismo del mercato. Sin da prima del fordismo, e poi con le rivoluzioni industriali, gli operai in fabbrica sono diventati ingranaggi dell’intero sistema assieme alle macchine. Questa dell’intelligenza artificiale è un’altra rivoluzione che è nel limbo tra il ticchettio e l’esplosione, una bomba “quasi pronta” a esplodere.

Ora infatti dipendenti e operai stanno col fiato sospeso, nell’attesa di vedere se sarà il loro “boss” a cambiare o se loro non avranno più un lavoro. Si tratta di un cambiamento nel dialogo, di una nuova dinamica alla quale ci dovremo di sicuro abituare. Specialmente le nuove generazioni che dovranno specializzarsi ulteriormente e cercare risposte a nuove domande mai poste prima. Le “vecchie” però stanno cercando di creare un piano regolatore, salvaguardando l’oggi e il domani.

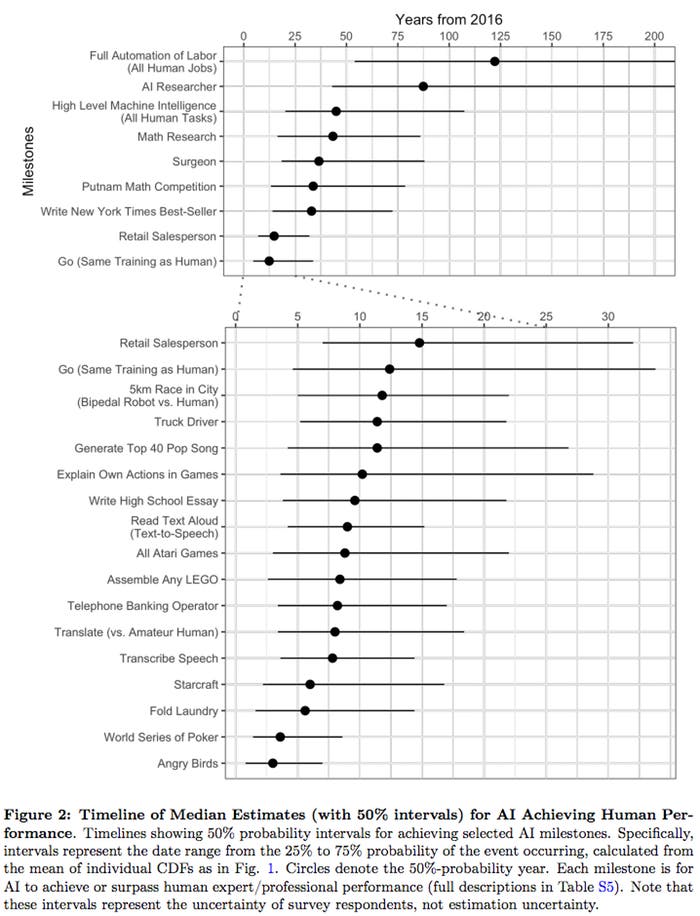

Sondaggio del 2017 sul potenziale dell’AI. Alcuni traguardi sono già stati raggiunti molto in anticipo.

Dai 23 Principi di Asilomar…

Partiamo da uno dei piani più recenti ovvero i 23 Principi di Asilomar. Ne abbiamo già parlato brevemente nell’articolo sulle dieci innovazioni tech del decennio, ma è ora di citarli propriamente. La ricerca è lunga – se volete leggerla integralmente la trovate qui – e molto interessante, poiché tocca tantissimi punti proprio per creare uno scheletro concreto alla regolamentazione dell’intelligenza artificiale.

Quando nel 2017 Elon Musk, Stephen Hawking, Google, OpenAI, DeepMind, Apple e circa 1580 esperti di AI/Robotica e 3447 altre personalità hanno firmato tali principi, l’obiettivo era uno: rendere l’AI benefica per l’essere umano. Come? Stabilendo norme riguardanti gli investimenti nel settore, la base culturale-psicologica priva di bias o altri elementi controproducenti, invitando a trasparenza, sicurezza, responsabilità, valori umani, tutela della privacy, cautela e bene comune. Le domande fondamentali infatti sono:

- Cosa serve per rendere i futuri sistemi di AI abbastanza forti da evitare malfunzionamenti o attacchi hacker?

- Come possiamo prosperare attraverso l’automazione, assicurando comunque risorse alle persone?

- Come possiamo aggiornare i nostri sistemi legali per renderli efficienti, uguali per tutti, al passo con l’AI e anche in grado di gestire i rischi dell’AI?

- Quale set di valori va affiancato all’AI e quale status etico-legale dovrebbe avere tale tecnologia?

Serve un alto livello di cooperazione tra gli esperti, ma anche fiducia da parte del cittadino verso di essi dato che si stanno ponendo come l’”intermediario” tra una tecnologia dalle potenzialità ancora quasi ignote e l’essere umano. Oggi però l’impronta culturale occidentale moderna che caratterizza il modo di fare delle vecchie generazioni sta portando il tutto a uno stallo pericoloso. Dunque, come si può rimuovere questo blocco?

…al Vaticano, tra etica, diritto e salute

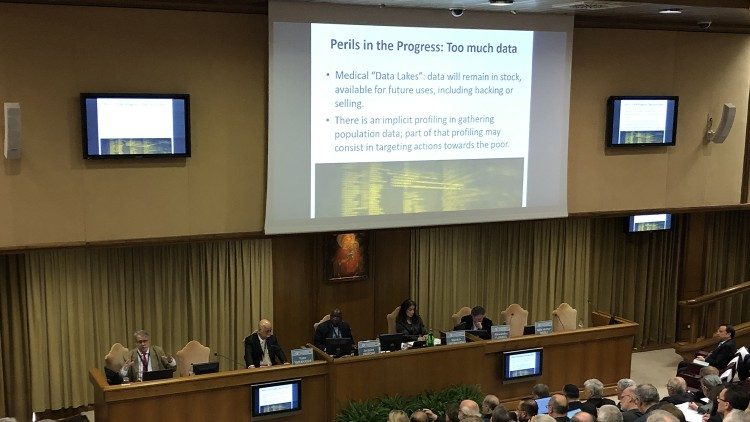

Un altro passo è il recente convegno sull’AI promosso dalla Pontificia Accademia per la Vita che si chiuderà oggi, 29 febbraio, in Vaticano. In questa occasione, intitolata “Il ‘buon’ algoritmo? Intelligenza Artificiale: Etica, Diritto, Salute” anche Papa Francesco si è espresso al riguardo. Toccando temi che vanno dalla privacy alla medicina all’etica e bioetica, il Papa ha chiarito che questo è un “crocevia epocale”, la nuova rivoluzione dopo la stampa, la macchina a vapore e l’elettricità.

“La tecnologia che popola la “galassia digitale” è “un dono di Dio”. Ma è anche una risorsa dai risvolti complessi, in cui il rapporto tra “l’apporto propriamente umano e il calcolo automatico” va studiato bene perché non sempre è facile prevederne gli effetti e definirne le responsabilità.”

Secondo lui ora c’è una grave situazione di disuguaglianza, una profonda asimmetria tra l’uomo e gli algoritmi poiché ciò che il primo rilascia nella Rete viene estratti dai secondi per trarne dati fondamentali per il mercato. Ancora, Francesco riconosce i pregi e vantaggi di tale tecnologia ma ritiene anche necessario e “nostro impegno tutelare e promuovere gli interrogativi etici per l’utilizzo dei nuovi dispositivi”. Tutto ciò verso una nuova frontiera, dal Papa definita algor-etica, ovvero “un ponte in grado di far sì che i principi si inscrivano concretamente nelle tecnologie digitali attraverso un effettivo dialogo transdisciplinare”.

Tanti principi, ma dove si va?

La strada da percorrere è decisamente lunga, i presupposti ci sono tutti ma manca ancora un fattore fondamentale: un cambiamento nell’atteggiamento dell’essere umano. Citando ancora Kasparov, che ha pure parzialmente anticipato le parole dette ieri da Papa Francesco:

“Le persone dicono che dovremmo creare un’AI etica. Ma è ancora una cosa senza senso. Gli uomini hanno ancora il monopolio sul male. Il problema non è l’AI, il problema sono gli umani che usano le nuove tecnologie per fare del male ad altri umani. L’AI è come uno specchio, amplifica il bene ma anche il male. Non è Terminator o una bacchetta magica, nemmeno utopia o distopia, è uno strumento unico che potrebbe elevare la nostra mente. Ma ad oggi il problema è ancora legato all’uomo.”

Una critica dalla quale è difficile staccarsi perché è tristemente vera. Il timore maggiore attuale, ovvero il rifiuto dell’intelligenza artificiale causato dalla possibile sostituzione del lavoratore umano, è semplicemente un capro espiatorio sulla quale tantissimi sociologi si focalizzano. Non è certamente un problema da sottovalutare. Però il problema fondamentale alla radice del limbo in cui si trova l’AI è la paura degli utilizzi possibili da parte dell’uomo stesso.

Droni militari autocomandati, armi più tecnologiche, guerriglie informatiche. Le possibilità sono tante e sono tutte spaventose. Per di più, la loro soluzione pacifica e benefica è ancor più distante se si considerano certe personalità al potere attualmente e la portata mediatica che hanno, oltre che tipo di consenso. Come diceva Hans Jonas, serve un’etica per la civiltà tecnologica, un’etica cosmica basata su “dovere della paura” e “coraggio della responsabilità”, non solo per rispondere ai quesiti relativi a sovrappopolazione, problemi energetici e ambientali e salvaguardia delle generazioni successive, ma anche per definire il nostro ruolo accanto all’intelligenza artificiale.

Agendo in modo tale che gli effetti delle nostre azioni siano compatibili con la continuazione di una vita autenticamente umana. Anche se, come si suol dire, 2.0.

Per rimanere informati sul mondo nerd, continuate a seguirci sul nostro sito DrCommodore.it e su Facebook, Instagram, Telegram, YouTube, Discord, Steam e Twitch.