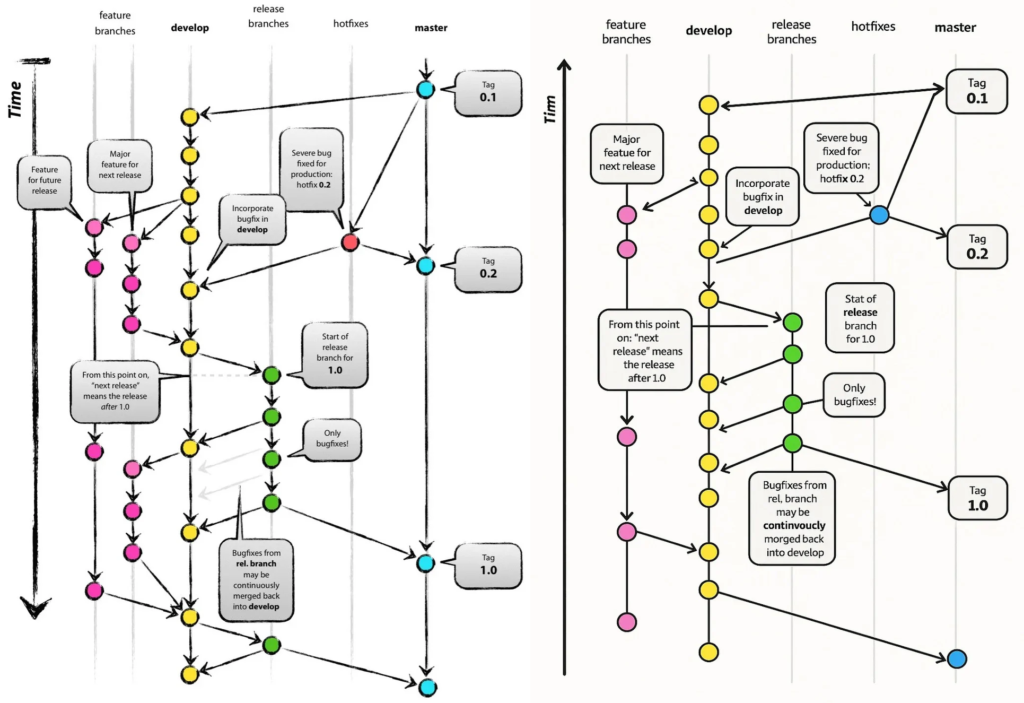

Il colosso Microsoft sta attraversando un periodo d’immagine decisamente complicato, tanto che sui social ha iniziato a circolare con insistenza l’hashtag Microslop per descrivere le implementazioni AI di scarsa qualità introdotte in Windows 11. L’ultimo scivolone è avvenuto su una pagina di supporto ufficiale di GitHub, dove è apparso un diagramma tecnico chiaramente generato da un’intelligenza artificiale, ma farcito di errori macroscopici.

Il grafico, prontamente rimosso ma ancora disponibile in rete (e proposto di seguit), mirava a spiegare i flussi di branching, ma per sfortuna di chi lo ha pubblicato senza accorgersene, esso riportava scritte prive di senso logico come “continvoucly morged” e collegamenti randomici, un chiaro segnale di un’allucinazione visiva del modello generativo. La questione è diventata virale quando Vincent Driessen, lo sviluppatore che quindici anni fa creò il diagramma originale a cui l’AI si è ispirata, ha denunciato l’accaduto.

I wrote a few words last night. nvie.com/posts/15-yea…

— Vincent Driessen (@nvie.com) 18 febbraio 2026 alle ore 06:55

[image or embed]

Il paradosso della vicenda, come sottolineato dallo stesso Vincent Driessen, risiede nel fatto che il suo lavoro originale era stato rilasciato con licenza libera e chiunque avrebbe potuto usarlo e adattarlo semplicemente citando la fonte. Invece, Microsoft ha preferito affidarsi a un’intelligenza artificiale che ha prodotto una versione esteticamente peggiore, meno leggibile e priva di qualsiasi credito all’autore originale.

Sulla vicenda è intervenuto Scott Hanselman, figura di spicco nei rapporti con la community di sviluppatori, definendo l’episodio come l’errore di un “collaboratore troppo zelante”. Pur promettendo controlli più rigorosi, l’incidente ha alimentato i dubbi sulla reale supervisione umana dietro i contenuti prodotti dall’azienda.

Harry Potter e la pirateria involontaria: il dataset della discordia

Se il caso del grafico ha sollevato polemiche sulla qualità, un secondo scivolone ha invece toccato il delicato tema del diritto d’autore. Microsoft è stata costretta a rimuovere un post dal suo blog tecnico ufficiale (ancora disponibile su web archive) dopo che la community di Hacker News ha sollevato un polverone etico e legale.

L’articolo, firmato da un senior product manager, suggeriva agli sviluppatori di utilizzare un dataset contenente i sette libri della saga di Harry Potter per addestrare modelli linguistici e creare chatbot o fan fiction. Peccato che l’intera opera di J.K. Rowling sia protetta da copyright e il dataset suggerito, seppur classificato erroneamente come di dominio pubblico, contenesse di fatto materiale pirata. L’esempio proposto nel blog era quasi grottesco, in quanto mostrava il giovane mago incontrare un amico sull’Hogwarts Express intento a spiegare le funzionalità di Azure nel mondo babbano, il tutto corredato da immagini AI con il logo dell’azienda.

Non solo Harry Potter, ma anche i riferimenti al ciclo della Fondazione di Isaac Asimov sono finiti nel mirino, trattandosi anch’essi di opere non ancora di pubblico dominio. Sebbene l’articolo sia stato rimosso dopo l’intervento di testate come Ars Technica, il dataset era già stato scaricato oltre diecimila volte. Nonostante il vuoto normativo sul “fair use” nell’addestramento delle AI possa proteggere legalmente l’azienda, resta il danno d’immagine per una società che ha tecnicamente promosso la condivisione di materiale protetto senza licenza.